L’essor de l’automatisation dans les environnements industriels transforme radicalement les méthodes de production et soulève simultanément des questions juridiques complexes. À mesure que les robots, les systèmes autonomes et l’intelligence artificielle remplacent ou complètent le travail humain, le cadre juridique traditionnel se trouve confronté à des défis inédits. La détermination de la responsabilité en cas d’accident, de dysfonctionnement ou de préjudice causé par ces technologies devient une préoccupation majeure pour les législateurs, les tribunaux et les entreprises. Cette analyse juridique approfondie examine les fondements de la responsabilité dans le contexte de l’automatisation industrielle, en tenant compte des évolutions législatives récentes et des jurisprudences émergentes dans ce domaine en perpétuelle mutation.

Fondements juridiques de la responsabilité dans l’automatisation industrielle

Le cadre juridique encadrant l’automatisation industrielle repose sur plusieurs piliers fondamentaux qui déterminent la répartition des responsabilités entre les différents acteurs. La responsabilité civile constitue le socle traditionnel sur lequel s’appuient de nombreuses actions en justice liées aux dommages causés par les systèmes automatisés. En droit français, cette responsabilité se décline principalement à travers les articles 1240 et suivants du Code civil qui établissent le principe selon lequel tout fait quelconque de l’homme qui cause à autrui un dommage oblige celui par la faute duquel il est arrivé à le réparer.

Dans le contexte spécifique de l’automatisation, la responsabilité du fait des produits défectueux, codifiée aux articles 1245 à 1245-17 du Code civil, revêt une importance particulière. Issue de la directive européenne 85/374/CEE, cette responsabilité permet d’engager la responsabilité du producteur lorsqu’un défaut de son produit cause un dommage. Pour les systèmes automatisés, la question de la défectuosité peut s’avérer particulièrement complexe, notamment lorsque le système intègre des capacités d’auto-apprentissage.

La responsabilité contractuelle intervient quant à elle dans les relations entre le fournisseur de la solution automatisée et l’entreprise utilisatrice. Les contrats de vente, de maintenance ou de service définissent les obligations respectives des parties et prévoient généralement des clauses de garantie, de limitation ou d’exonération de responsabilité dont la validité peut être contestée devant les tribunaux.

Spécificités de la responsabilité des robots industriels

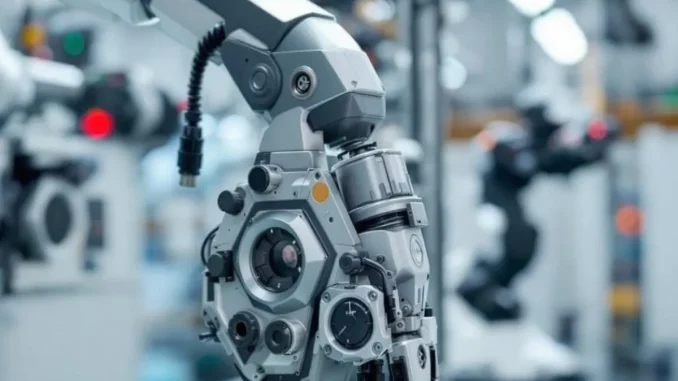

Les robots industriels posent des questions juridiques particulières en raison de leur autonomie relative et de leur interaction physique avec l’environnement. La jurisprudence tend à considérer que le propriétaire ou l’utilisateur du robot assume une responsabilité de garde au sens de l’article 1242 du Code civil. Toutefois, cette qualification peut être remise en cause lorsque le robot présente un défaut de conception ou de fabrication, permettant alors un recours contre le fabricant.

Le Parlement européen a adopté en 2017 une résolution contenant des recommandations à la Commission concernant des règles de droit civil sur la robotique, suggérant notamment la création d’un statut juridique spécifique pour les robots les plus sophistiqués. Cette initiative, bien que non contraignante, témoigne de la prise de conscience des enjeux juridiques liés à l’automatisation.

- Responsabilité civile délictuelle (articles 1240 et suivants du Code civil)

- Responsabilité du fait des produits défectueux (articles 1245 à 1245-17 du Code civil)

- Responsabilité contractuelle (articles 1231 et suivants du Code civil)

- Responsabilité du fait des choses que l’on a sous sa garde (article 1242 du Code civil)

La complexité des systèmes automatisés moderne rend parfois difficile l’identification de la cause exacte d’un dommage, compliquant ainsi l’attribution des responsabilités. Cette problématique est particulièrement prégnante lorsque plusieurs acteurs interviennent dans la chaîne de conception, de production et d’utilisation du système automatisé.

Responsabilité des fabricants et concepteurs de systèmes automatisés

Les fabricants et concepteurs de systèmes automatisés occupent une place centrale dans la chaîne de responsabilité juridique. Leur position les expose à différents régimes de responsabilité qui peuvent se cumuler en fonction des circonstances et de la nature du préjudice causé. La responsabilité du fait des produits défectueux constitue le principal fondement juridique permettant d’engager leur responsabilité.

Cette responsabilité présente plusieurs caractéristiques distinctives. Elle est d’abord objective, ce qui signifie qu’elle ne nécessite pas la démonstration d’une faute du fabricant. La victime doit simplement prouver le défaut du produit, le dommage subi et le lien de causalité entre les deux. Elle est ensuite solidaire entre les différents acteurs de la chaîne de production, permettant à la victime d’agir contre le fabricant du produit fini, le fabricant d’une partie composante ou encore l’importateur.

Les obligations d’information et de suivi constituent un autre aspect fondamental de la responsabilité des fabricants. Ces derniers doivent fournir des informations claires et complètes sur l’utilisation, les limites et les risques associés à leurs systèmes automatisés. Cette obligation se prolonge après la mise sur le marché, imposant une veille sur les risques émergents et, le cas échéant, le rappel des produits présentant un danger.

Conception sécuritaire et conformité normative

La conception sécuritaire des systèmes automatisés représente une obligation primordiale pour les fabricants. Le respect des normes techniques constitue un élément central dans l’appréciation du caractère défectueux ou non d’un système. Les normes ISO 10218-1 et ISO 10218-2 relatives à la sécurité des robots industriels, ou encore la norme ISO/TS 15066 pour les robots collaboratifs, définissent des exigences minimales que les fabricants doivent respecter.

La directive Machines 2006/42/CE, transposée en droit français, impose aux fabricants de procéder à une évaluation des risques et d’intégrer la sécurité dès la conception. Le non-respect de ces obligations peut constituer un élément déterminant dans l’établissement de la responsabilité du fabricant en cas d’accident.

Pour les systèmes intégrant de l’intelligence artificielle, la question de la prévisibilité des comportements pose des défis juridiques particuliers. Le Règlement européen sur l’intelligence artificielle, en cours d’élaboration, prévoit des obligations spécifiques pour les systèmes d’IA à haut risque, incluant de nombreuses applications industrielles.

- Évaluation des risques dès la phase de conception

- Documentation technique exhaustive

- Mise en place de systèmes de surveillance post-commercialisation

- Formation adéquate des utilisateurs

Les moyens d’exonération dont disposent les fabricants sont strictement encadrés. L’article 1245-10 du Code civil prévoit notamment l’exonération lorsque l’état des connaissances scientifiques et techniques au moment de la mise en circulation du produit ne permettait pas de déceler l’existence du défaut. Cette cause d’exonération, connue sous le nom de « risque de développement », fait l’objet d’interprétations restrictives par les tribunaux, particulièrement dans le domaine des technologies avancées où le niveau d’expertise attendu des fabricants est élevé.

Obligations et responsabilités des utilisateurs industriels

Les entreprises utilisatrices de systèmes automatisés assument des responsabilités juridiques substantielles qui découlent tant de leur qualité d’employeur que de leur statut de gardien de la chose. Ces responsabilités s’articulent autour de plusieurs obligations fondamentales qui, si elles ne sont pas respectées, peuvent engager leur responsabilité civile voire pénale.

L’obligation de sécurité constitue la pierre angulaire de la responsabilité des utilisateurs industriels. Le Code du travail, notamment à travers l’article L. 4121-1, impose à l’employeur de prendre les mesures nécessaires pour assurer la sécurité et protéger la santé physique et mentale des travailleurs. Cette obligation de résultat s’applique pleinement dans le contexte de l’automatisation industrielle et exige une vigilance accrue face aux risques spécifiques posés par les machines autonomes.

La formation et l’information des salariés représentent un volet majeur de ces obligations. L’employeur doit s’assurer que les opérateurs disposent des connaissances nécessaires pour interagir en toute sécurité avec les systèmes automatisés. Cette formation doit être régulièrement mise à jour pour tenir compte des évolutions technologiques et des risques émergents.

Maintien en conformité et surveillance des systèmes

L’utilisateur industriel assume une responsabilité continue concernant la maintenance et le contrôle des systèmes automatisés. La jurisprudence considère généralement que l’entreprise utilisatrice, en tant que gardienne de la chose au sens de l’article 1242 du Code civil, est présumée responsable des dommages causés par les machines qu’elle exploite, même en l’absence de faute prouvée.

Cette présomption de responsabilité ne peut être écartée que dans des circonstances limitées, notamment en cas de force majeure ou lorsque la cause exclusive du dommage réside dans un défaut de conception ou de fabrication. Dans ce dernier cas, l’entreprise utilisatrice pourra exercer un recours contre le fabricant, mais demeure généralement le premier interlocuteur des victimes.

La documentation des procédures de sécurité et la traçabilité des opérations revêtent une importance cruciale pour les utilisateurs industriels. En cas d’incident, la capacité à démontrer le respect des protocoles de sécurité et la réalisation des contrôles requis constitue un élément déterminant dans l’appréciation de la responsabilité.

- Évaluation régulière des risques liés aux systèmes automatisés

- Mise en place de procédures d’arrêt d’urgence efficaces

- Documentation des incidents et des mesures correctives

- Vérification périodique de la conformité aux normes en vigueur

Les contrats conclus avec les fournisseurs de systèmes automatisés méritent une attention particulière. Les clauses de garantie, de maintenance ou de limitation de responsabilité doivent être soigneusement négociées et analysées. La jurisprudence tend à considérer que certaines clauses limitatives de responsabilité, notamment celles concernant les dommages corporels, peuvent être invalidées lorsqu’elles vident substantiellement l’obligation de sécurité de sa substance.

Enjeux spécifiques de l’intelligence artificielle dans l’automatisation

L’intégration de l’intelligence artificielle (IA) dans les systèmes d’automatisation industrielle soulève des questions juridiques inédites qui transcendent les cadres traditionnels de responsabilité. La capacité d’apprentissage et d’adaptation de ces systèmes introduit une forme d’imprévisibilité qui complique l’attribution des responsabilités en cas de dommage.

Le concept d’autonomie décisionnelle des systèmes d’IA remet en question les fondements mêmes de la responsabilité juridique. Lorsqu’un système prend des décisions basées sur son apprentissage plutôt que sur une programmation explicite, la détermination du lien causal entre la conception du système et le dommage devient problématique. Cette difficulté est accentuée par l’opacité algorithmique qui caractérise certains systèmes d’apprentissage profond dont le fonctionnement s’apparente à une « boîte noire ».

La Commission européenne a proposé en avril 2021 un règlement sur l’intelligence artificielle qui établit une approche fondée sur les risques. Ce texte, encore en discussion, prévoit des obligations renforcées pour les systèmes d’IA considérés comme à « haut risque », catégorie qui inclut de nombreuses applications industrielles. Ces obligations comprennent notamment des exigences en matière de données d’entraînement, de documentation technique, de transparence et de surveillance humaine.

Responsabilité et explicabilité des décisions automatisées

L’explicabilité des décisions prises par les systèmes d’IA devient un enjeu juridique majeur. Le Règlement Général sur la Protection des Données (RGPD) consacre déjà, dans son article 22, un droit de ne pas faire l’objet d’une décision fondée exclusivement sur un traitement automatisé. Ce principe, initialement conçu pour protéger les personnes physiques, influence progressivement la conception des systèmes industriels en imposant une forme de transparence algorithmique.

La notion de contrôle humain significatif émerge comme un standard juridique en construction. Elle implique que, malgré l’autonomie du système, un opérateur humain doit conserver la capacité de comprendre, de superviser et, si nécessaire, d’intervenir dans le processus décisionnel. Cette exigence se traduit concrètement par des obligations de conception permettant l’intervention humaine et par la formation adéquate des opérateurs.

La traçabilité des décisions algorithmiques constitue un autre aspect fondamental de la responsabilité juridique dans ce domaine. La capacité à reconstituer le cheminement décisionnel d’un système d’IA devient indispensable tant pour l’analyse des incidents que pour l’attribution des responsabilités. Cette exigence impose aux concepteurs la mise en place de systèmes de journalisation sophistiqués et d’outils d’analyse a posteriori.

- Conception de systèmes d’IA interprétables par nature

- Mise en place d’outils d’explication des décisions algorithmiques

- Conservation des données d’entraînement et des paramètres du modèle

- Documentation des choix de conception influençant le comportement du système

Le concept de responsabilité par conception (responsibility by design) gagne en importance dans ce contexte. Il s’agit d’intégrer, dès les premières phases de développement, des mécanismes permettant d’attribuer clairement les responsabilités en cas de dysfonctionnement. Cette approche préventive complète les mécanismes traditionnels de responsabilité curative et s’inscrit dans une tendance plus large de régulation proactive des technologies émergentes.

Aspects internationaux et comparatifs de la responsabilité

La dimension internationale de l’automatisation industrielle soulève des questions complexes de conflits de lois et de juridictions compétentes. Les chaînes de valeur globalisées impliquent souvent des acteurs établis dans différents pays, compliquant ainsi la détermination du droit applicable en cas de litige. Le Règlement Rome II sur la loi applicable aux obligations non contractuelles fournit un cadre pour résoudre ces conflits au sein de l’Union européenne, privilégiant généralement la loi du pays où le dommage survient.

Les approches juridiques de la responsabilité liée à l’automatisation varient sensiblement selon les traditions juridiques. Les systèmes de common law, comme ceux des États-Unis ou du Royaume-Uni, accordent une place prépondérante à la jurisprudence et développent des solutions au cas par cas. À l’inverse, les systèmes de droit civil, dont la France fait partie, s’appuient davantage sur des cadres législatifs structurés qui s’adaptent progressivement aux nouvelles technologies.

Les États-Unis se caractérisent par une approche relativement fragmentée de la régulation de l’automatisation industrielle. Au niveau fédéral, des agences comme l’Occupational Safety and Health Administration (OSHA) édictent des normes générales de sécurité, tandis que les États peuvent adopter des législations spécifiques. La responsabilité civile américaine, marquée par l’importance des class actions et des dommages punitifs, crée un environnement juridique particulièrement risqué pour les fabricants de systèmes automatisés.

Initiatives réglementaires et tendances émergentes

L’Union européenne se positionne comme un leader mondial dans la régulation des technologies émergentes, y compris l’automatisation industrielle. Outre le projet de règlement sur l’intelligence artificielle déjà mentionné, la Commission européenne a publié en 2020 un rapport sur les implications en matière de sécurité et de responsabilité de l’IA, de l’Internet des objets et de la robotique. Ce document préconise notamment une révision de la directive sur la responsabilité du fait des produits pour l’adapter aux spécificités des technologies autonomes.

Le Japon, pionnier en robotique industrielle, développe une approche distinctive caractérisée par une collaboration étroite entre pouvoirs publics et industrie. Le concept de Society 5.0, promu par le gouvernement japonais, vise une intégration harmonieuse des technologies avancées dans tous les aspects de la société, y compris l’industrie. Sur le plan juridique, cette vision se traduit par un cadre réglementaire qui favorise l’innovation tout en intégrant des considérations éthiques.

La Chine a adopté en 2021 une réglementation spécifique sur l’intelligence artificielle qui impacte directement l’automatisation industrielle. Cette réglementation met l’accent sur la sécurité nationale et le contrôle étatique, imposant des obligations strictes aux développeurs et utilisateurs de technologies autonomes. Cette approche diverge sensiblement des modèles occidentaux qui accordent une place plus importante à la protection des droits individuels.

- Harmonisation progressive des normes techniques internationales (ISO/IEC)

- Développement de mécanismes de certification transnationaux

- Émergence de principes éthiques communs pour l’automatisation responsable

- Coopération internationale en matière de surveillance des risques

Les organisations internationales jouent un rôle croissant dans l’élaboration de standards partagés. L’Organisation de Coopération et de Développement Économiques (OCDE) a adopté en 2019 des principes directeurs sur l’intelligence artificielle qui, bien que non contraignants, influencent les approches réglementaires nationales. De même, l’Organisation Internationale de Normalisation (ISO) développe activement des normes techniques dans le domaine de la robotique et de l’automatisation qui servent souvent de référence pour apprécier la conformité des systèmes aux standards de l’industrie.

Perspectives d’évolution du cadre juridique face aux innovations technologiques

L’accélération des innovations technologiques dans le domaine de l’automatisation industrielle appelle une adaptation constante du cadre juridique. Le développement des systèmes cyber-physiques, l’essor de l’Internet des Objets Industriel (IIoT) et l’émergence de l’informatique quantique transforment profondément les capacités des systèmes automatisés et génèrent de nouveaux risques juridiques.

La tendance vers une responsabilité préventive se renforce, privilégiant l’anticipation des risques plutôt que la seule réparation des dommages. Cette évolution se manifeste par l’émergence de concepts tels que la diligence raisonnable algorithmique qui impose aux concepteurs et utilisateurs de systèmes automatisés une obligation d’évaluation continue des risques potentiels. Cette approche proactive complète les mécanismes traditionnels de responsabilité sans pour autant les remplacer.

La question de la personnalité juridique des systèmes autonomes fait l’objet de débats académiques et institutionnels. Si l’attribution d’une personnalité juridique complète aux robots demeure largement théorique, des formes intermédiaires de reconnaissance juridique pourraient émerger. L’établissement de patrimoines d’affectation dédiés à la couverture des risques liés à certains systèmes autonomes constitue une piste explorée par plusieurs experts.

Mécanismes d’indemnisation et gestion collective des risques

Face à la complexité croissante des chaînes de responsabilité, de nouveaux mécanismes d’indemnisation se développent. L’instauration de fonds de garantie spécifiques, sur le modèle de ce qui existe déjà pour certains risques technologiques, permettrait d’assurer une indemnisation rapide des victimes indépendamment de la détermination précise des responsabilités. Ces dispositifs pourraient être financés par les acteurs de l’industrie proportionnellement à leur part de marché ou au niveau de risque de leurs produits.

Le rôle des assurances évolue significativement dans ce contexte. Les assureurs développent des polices spécifiques pour couvrir les risques liés à l’automatisation et à l’intelligence artificielle. Ces produits d’assurance s’accompagnent généralement d’exigences en matière d’évaluation des risques et de mesures préventives, contribuant ainsi à l’élévation des standards de sécurité dans l’industrie.

La cybersécurité devient une composante majeure de la responsabilité juridique dans l’automatisation industrielle. Les systèmes connectés présentent des vulnérabilités spécifiques qui peuvent être exploitées à des fins malveillantes. La directive européenne NIS 2 (Network and Information Security), adoptée en 2022, renforce considérablement les obligations des opérateurs d’infrastructures critiques, incluant de nombreux sites industriels automatisés.

- Développement de mécanismes de certification de cybersécurité pour les systèmes industriels

- Création de procédures standardisées de gestion des incidents

- Établissement de responsabilités partagées entre fabricants et utilisateurs

- Obligation de mise à jour des systèmes tout au long de leur cycle de vie

La soft law et l’autorégulation occupent une place grandissante dans l’encadrement juridique de l’automatisation. Les codes de conduite sectoriels, les chartes éthiques et les mécanismes de certification volontaire complètent utilement la réglementation contraignante. Cette complémentarité entre hard law et soft law permet d’adapter plus rapidement le cadre normatif aux évolutions technologiques tout en maintenant un niveau élevé de protection.

Le dialogue entre droit et technique s’intensifie, avec l’émergence de concepts comme le legal by design qui vise à intégrer les exigences juridiques dès la conception des systèmes automatisés. Cette approche suppose une collaboration étroite entre juristes et ingénieurs pour développer des solutions technologiques intrinsèquement conformes aux exigences légales, facilitant ainsi la détermination des responsabilités en cas d’incident.

Vers une approche équilibrée de la responsabilité juridique

L’analyse approfondie des différentes facettes de la responsabilité juridique dans l’automatisation industrielle révèle la nécessité d’une approche équilibrée qui concilie sécurité juridique et innovation technologique. Le défi majeur consiste à établir un cadre suffisamment protecteur pour les potentielles victimes tout en évitant de freiner le développement de technologies porteuses de progrès économiques et sociaux.

La proportionnalité des obligations juridiques en fonction des risques émerge comme un principe directeur. Les systèmes d’automatisation présentant les risques les plus élevés, notamment ceux impliquant une interaction physique avec les humains ou des décisions critiques, justifient un encadrement plus strict que les applications à faible impact. Cette gradation des exigences permet d’optimiser l’allocation des ressources réglementaires et de concentrer l’attention sur les technologies véritablement problématiques.

La standardisation technique joue un rôle fondamental dans la construction de ce cadre équilibré. Les normes ISO, IEC ou CENELEC dans le domaine de l’automatisation industrielle offrent des références objectives pour évaluer la conformité des systèmes aux attentes légitimes en matière de sécurité. La présomption de conformité attachée au respect de ces normes harmonisées fournit une sécurité juridique précieuse tant pour les fabricants que pour les utilisateurs.

Adaptation des compétences juridiques et techniques

L’évolution du cadre juridique de l’automatisation nécessite une adaptation des compétences professionnelles dans plusieurs domaines. Les juristes spécialisés doivent développer une compréhension approfondie des technologies qu’ils encadrent, tandis que les ingénieurs et concepteurs doivent intégrer les considérations juridiques dans leur travail quotidien. Cette convergence des expertises favorise l’émergence de solutions juridiquement robustes et techniquement réalisables.

La formation continue des différents acteurs de la chaîne de valeur prend une importance stratégique. Les magistrats, avocats, assureurs, mais aussi les responsables de conformité au sein des entreprises doivent actualiser régulièrement leurs connaissances pour appréhender efficacement les enjeux juridiques liés aux technologies émergentes. Des programmes spécifiques de formation interdisciplinaire se développent pour répondre à ce besoin.

Le partage d’expériences entre les différentes juridictions nationales contribue à l’élaboration de solutions juridiques innovantes. Les décisions judiciaires rendues dans des affaires impliquant des systèmes automatisés, encore relativement rares, constituent des précédents précieux qui alimentent la réflexion juridique globale. Les bases de données jurisprudentielles spécialisées facilitent cette circulation des connaissances juridiques.

- Développement de formations interdisciplinaires droit-ingénierie

- Création d’observatoires des pratiques contractuelles dans l’automatisation

- Mise en place de laboratoires d’innovation juridique

- Organisation de simulations de procès sur des cas complexes d’automatisation

La participation citoyenne aux débats sur l’encadrement juridique de l’automatisation gagne en importance. Les choix réglementaires dans ce domaine engagent l’avenir collectif et méritent une délibération démocratique approfondie. Les consultations publiques, les conférences de consensus et autres mécanismes participatifs permettent d’enrichir la réflexion juridique par la diversité des perspectives citoyennes.

L’équilibre entre responsabilité individuelle et responsabilité collective constitue un enjeu philosophique et juridique majeur. Si la détermination précise des responsabilités individuelles demeure un objectif légitime du système juridique, la complexité des systèmes automatisés modernes justifie parfois des approches plus collectives de la responsabilité. Cette tension productive entre individualisation et mutualisation façonnera durablement l’évolution du droit de l’automatisation industrielle.